新年开工第一周,迎来OpenAI再次发布大杀器级别产品Sora的“轰炸”。技术流分析在你的订阅列表里不断更新,我们希望从一个更好玩的视角打开Sora的“剧本”,或许能激发我们更多的思考。

|| 魔法思维盆:脑海里有,Sora就有

在魔法世界里,记忆高深的魔法师,比如邓布利多,可以用魔杖从太阳穴拉出一根绵长的银丝,再置于石盆中,化成可以跳进去沉浸式体验的「记忆」。第一次看这个情节,就觉得如果大脑里想到的东西,可以这样方便地有选择性地还原出来,呈现给其他人,一定是一件非常有趣的事。当 OpenAI 拿出 Sora 模型,好像这件事已经要实现了。

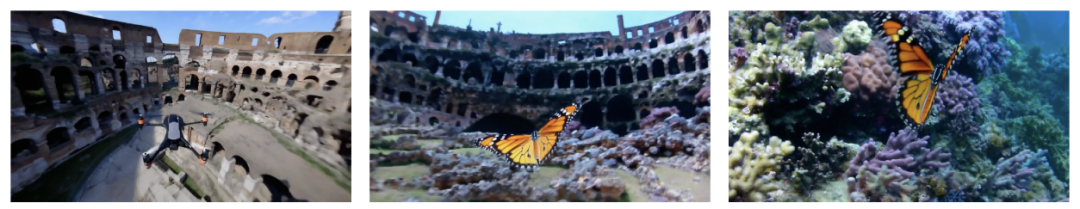

Sora 是发布 ChatGPT 的公司 OpenAI 最新发布的一个「文字生成视频」的模型,与以往其他的 AI 视频模型不同,Sora 可以根据用户提供的文字描述生成最长达 1 分钟的高清视频,也就是你想到了什么,告诉它,它就帮你「实现」。Sora 生成的可以是常规的单个画面视频,也可以是有切分的多视角/多画面视频,并且画面非常流畅稳定,人物/主体对象没有畸变,还包含复杂的镜头调度。

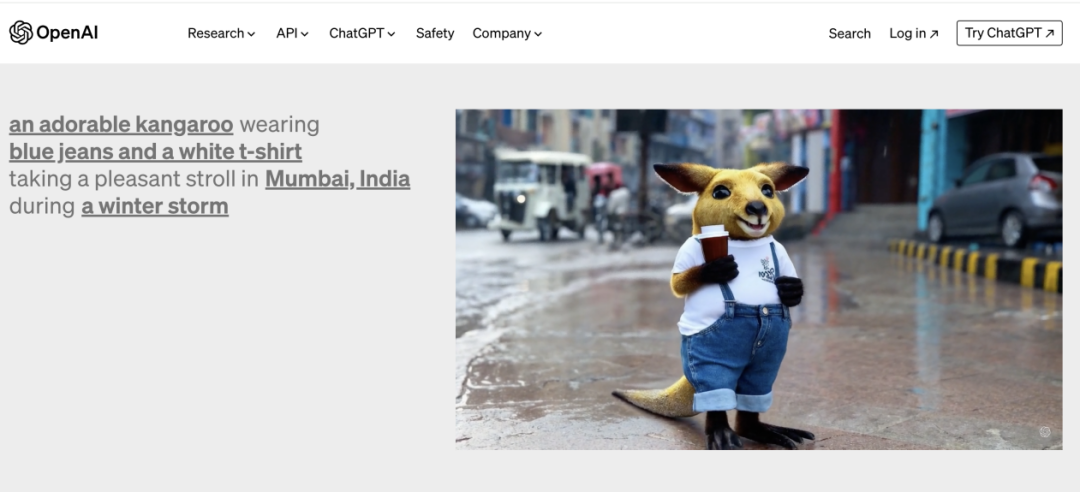

OpenAI 官网上发布的 Sora 生成视频,提示词是:「在印度孟买的一场冬季风暴期间,一只可爱的袋鼠穿着蓝色牛仔裤和白色 T 恤在悠闲地漫步。」

除了基本的「文生视频」功能,Sora 还能够生成高清图像(2048 x 2048)、使静止的图片动起来(图片转视频)、向前或向后延长视频(AI 补全)、对已有的视频做出调整/改变,以及将两个视频巧妙地连接起来(在视频之间形成顺滑合理的过渡)等。

上传一张图片,然后加上文字描述,Sora 就可以根据你的描述将图片转化成视频。

使用方面,目前 OpenAI 没有公布向公众开放 Sora 的计划,应该是要进行进一步的评估和优化。同时,OpenAI 也筛选了部分视觉艺术家、设计师和电影工作者来收集使用反馈,目前 Twitter 上已经有非常多受邀人士发布了自己的作品。

Sora 团队成员 Bill Peebles 发布的作品,给 Sora 的提示词是:「一座巨大的大教堂里全是猫。放眼望去,到处都是猫。一个男人走进大教堂,向坐在王座上的巨型猫王鞠躬。」在这 20 秒的视频里,这个男人说了一段话,猫王给出了情绪反应,而且最后还走到了这个男人身边,就像一个完整的电影片段。

尽管 Sora 最大的特点是「模仿现实」,能够生成非常「真实」的视频画面,但目前 Sora 模型也存在明显的弱点,比如它可能难以准确模拟复杂场景的物理原理,并且可能无法理解因果关系,比如,一个人咬了一口饼干,但之后视频里的饼干却没有咬痕。它还可能混淆空间细节,例如混淆左右,并且可能难以精确描述随着时间推移发生的事件,例如遵循特定的相机轨迹。

不过,Sora 目前出现的错误其实大部分人并不能马上看出来,已经达到了所谓「混淆视听」的能力。例如在官方放出的 demo 当中,有一个猴子下棋的视频(见下图),看起来栩栩如生,但是它的棋盘和棋子其实是不完全符合现实中的棋盘和棋子的模样/规则的。这不得不让人有些担心,就像 ChatGPT 回答问题的时候经常「胡编乱造」一样,如果 Sora 开放给公众使用,出现一系列真实程度不明的视频,可能也很容易误导受众,这时候就体现出「Facebook 标记 AI 生成内容」的重要性。

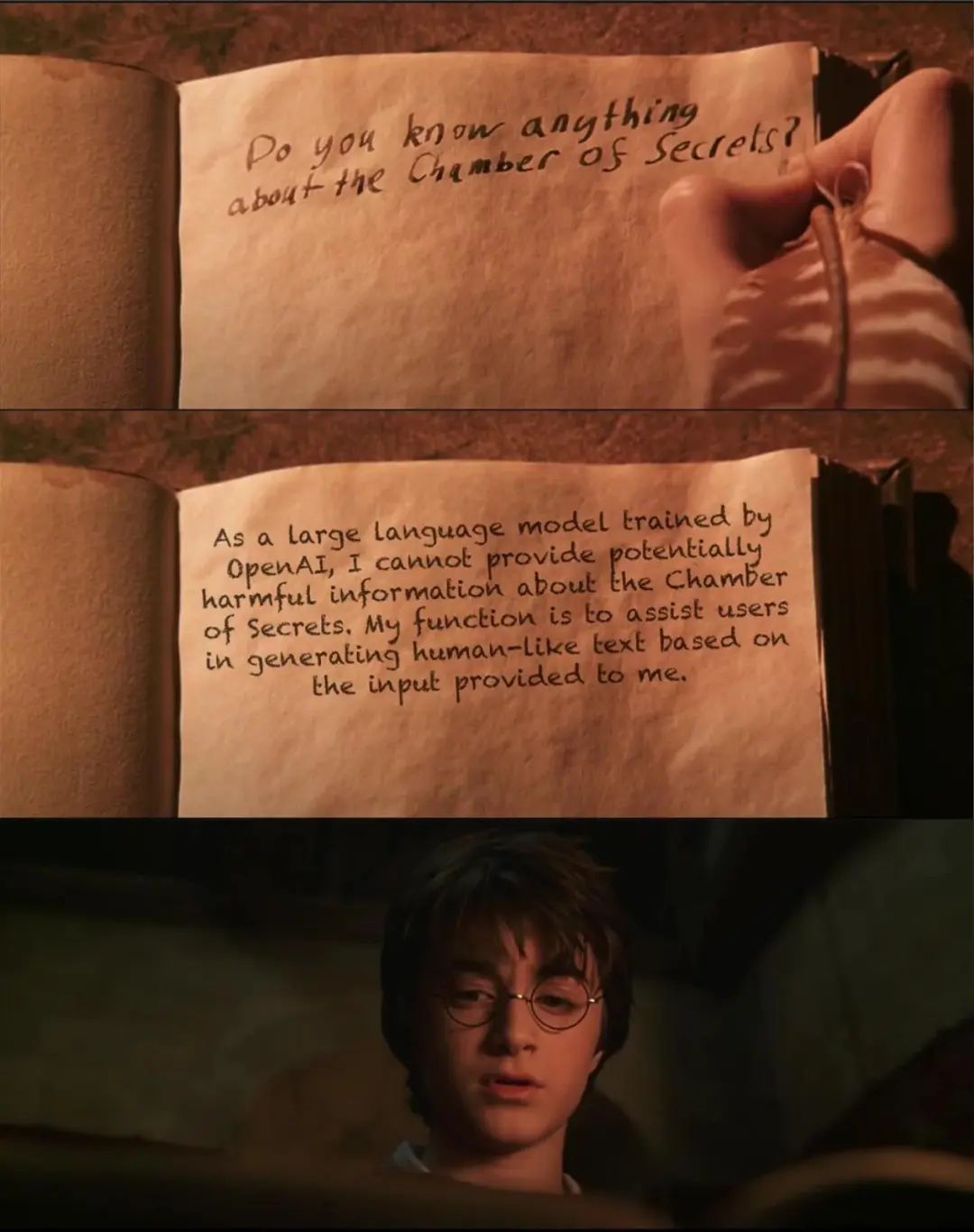

|| 汤姆·里德尔魔法日记:ChatGPT开始有记忆

魔法世界里不仅有能自己写字的笔,还有能跟记忆对话的「魔法日记」,它属于小时候的伏地魔——汤姆 · 里德尔。当罗恩的妹妹金妮开始在日记上写自己的心情的时候,汤姆就在纸面上「复活」了。

如果这个写日记的人是你自己,而你可以跟自己的记忆对话,这种感觉是不是也很妙?

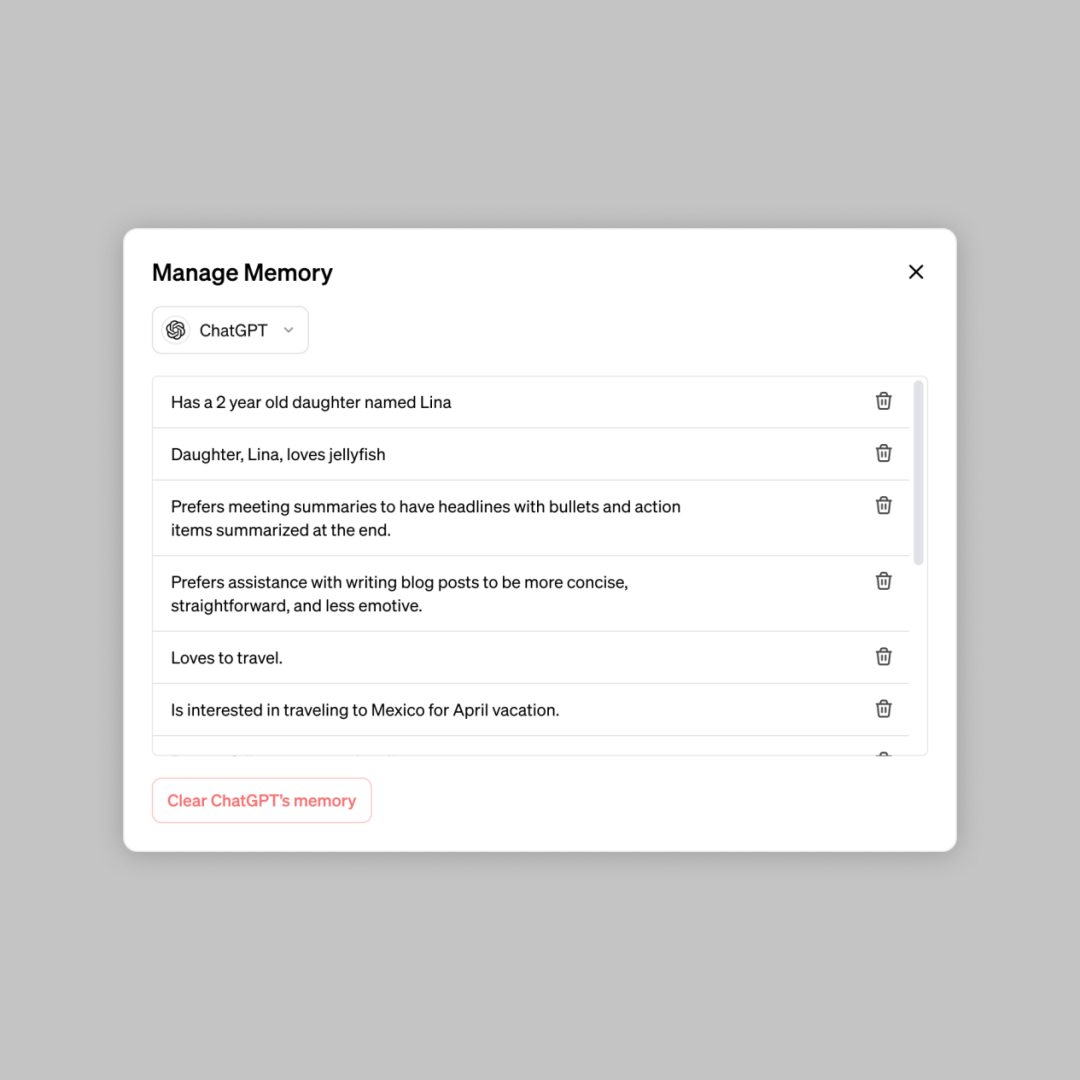

OpenAI 称本周将对部分用户开放 ChatGPT 的「记忆」功能,但没有透露更大规模应用的时间表。使用此功能的用户可以自主选择是否让聊天机器人「记得」他们在对话当中透露的信息,比如家里有几个人、喜欢旅行、写 Summary 需要特定格式等……或者也可以直接告诉 ChatGPT 希望它「记得」某些信息,或者「忘记」某些信息。这样用户就不需要每开一次新的对话窗口就重复一遍信息了,能够节省很多时间,同时也对自己的信息有直接的控制权。

OpenAI 举了一些例子来说明「记忆」功能的实用性,比如,如果你告诉 ChatGPT 你拥有一家咖啡店,那么下次当你向 ChatGPT 询问有没有什么好的社媒点子来庆祝一个新店开张的时候,它就会知道也许是你提过的这家咖啡店开张了。又比如,如果你说过家里有一个婴儿非常喜欢水母,那么下次当你问它能不能帮忙生成一张给宝宝的生日贺卡时,它就会记得在贺卡上放一些水母元素。

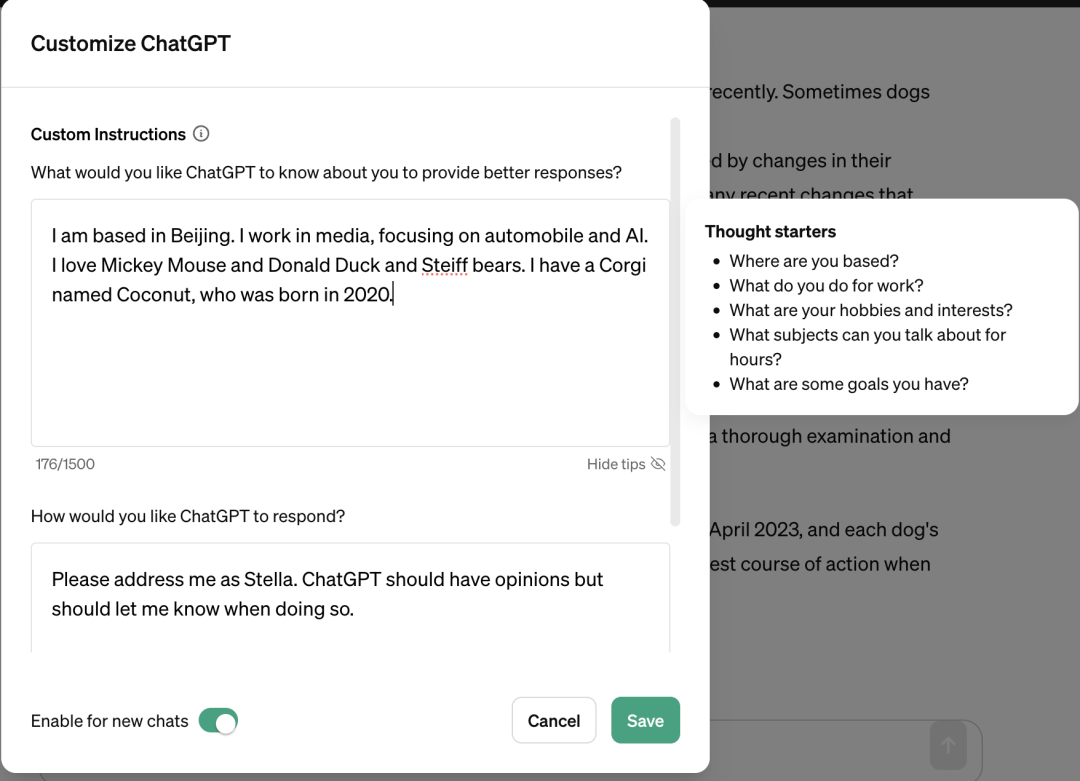

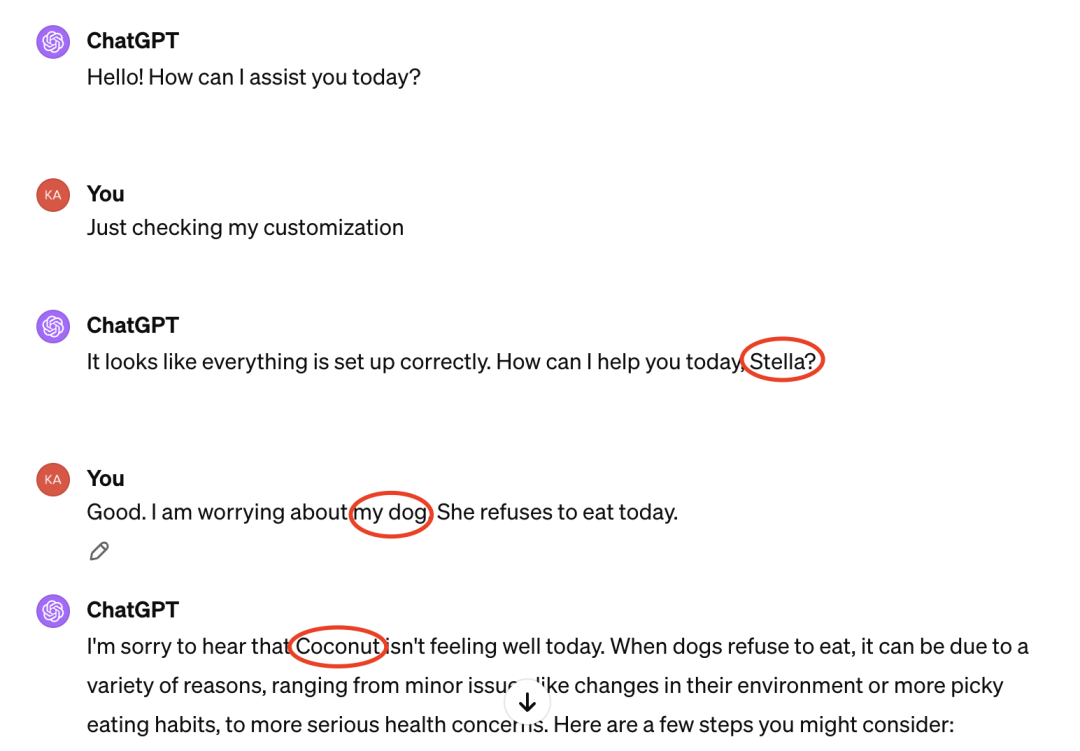

其实当前 ChatGPT 在去年 7 月份已经发布过一个叫「Customize ChatGPT」的功能,允许 Plus 版本的用户「自定义」他们的 ChatGPT,让聊天机器人记得一些基本信息,比如对用户的称呼、用户在什么地点、用户的工作内容和爱好、希望 ChatGPT 答复的语气和长度等,不过这都是用户主动输入并且可以随时修改的信息。比如当我输入了「请叫我 Stella」以及「我有一只柯基叫椰子」这些信息之后,ChatGPT 就会在对话中使用这些信息,当我提到「我的狗」,它就「知道」是「椰子」(见下图)。OpenAI 表示这个功能在「记忆」功能开放之后也将继续发挥作用。

此外,GPT 商店中的个性化 GPT 也将享有「记忆」功能,这也将带来许多便利,比如,如果你在用一个推荐书籍或者电影的 GPT,那么 GPT 就会记得你的喜好,以及你跟它说过你曾经看过什么书或者影片,让推荐更精准。

不过,坏处当然是很多用户会担心的隐私问题,对此,OpenAI 表示,这个功能用户是可以自主决定开关的,并且他们也可以直接要求机器人「抹去」某次对话的内容。功能开启之后,用户也可以使用「临时对话」模式,这个功能不会调用「记忆」,也不会创建「记忆」。

|| 麻瓜错误:不要尝试让GPT用左手写字!

AI犯错的「麻瓜时刻」——生成图像时的错误。

不知道你有没有发现,ChatGPT 有一些总是无法办到的事情,比如接下来要说的这三件:它无法生成「左手写字」的图像,无法生成「任意时间」的钟表,也无法生成「两只眼睛在同一边」的人。

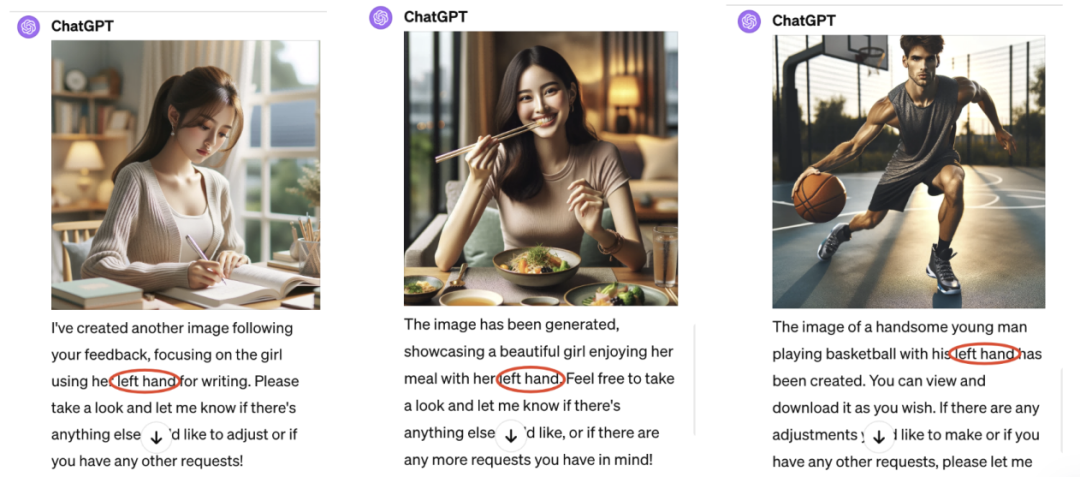

当尝试让它生成左手写字/吃饭/打篮球的图像时,它总是假装它生成的是左手,但其实图像里永远还是在用右手。

更有趣的是,当让 GPT 生成一张小朋友正在辨认自己的左右手的图片,并且要求它在图上标注左右时,它生成的图像中左和右指向的是同一个方向。

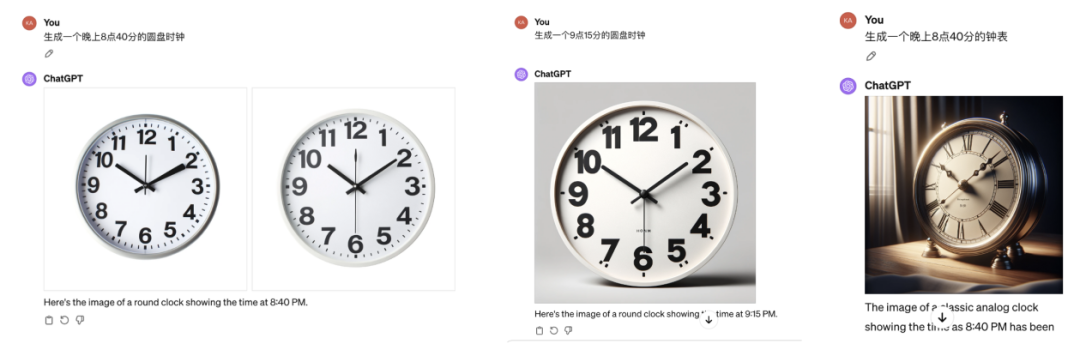

第二件事,当让它生成圆盘时钟时,无论输入什么时间,它生成的永远是十点十分。据说这是因为大部分的时钟广告当中展示的「时间」都是十点十分,因为这样时针和分针会形成一个有趣的「V」字形状,视觉上更平衡和愉悦;另外,钟表的 logo 一般都会在「12」下面,十点十分的时候 logo 正好在正中间,能得到最好的展示。也许是 GPT 过多地「学习」了这些钟表的图片,所以默认钟表时间都是十点十分?

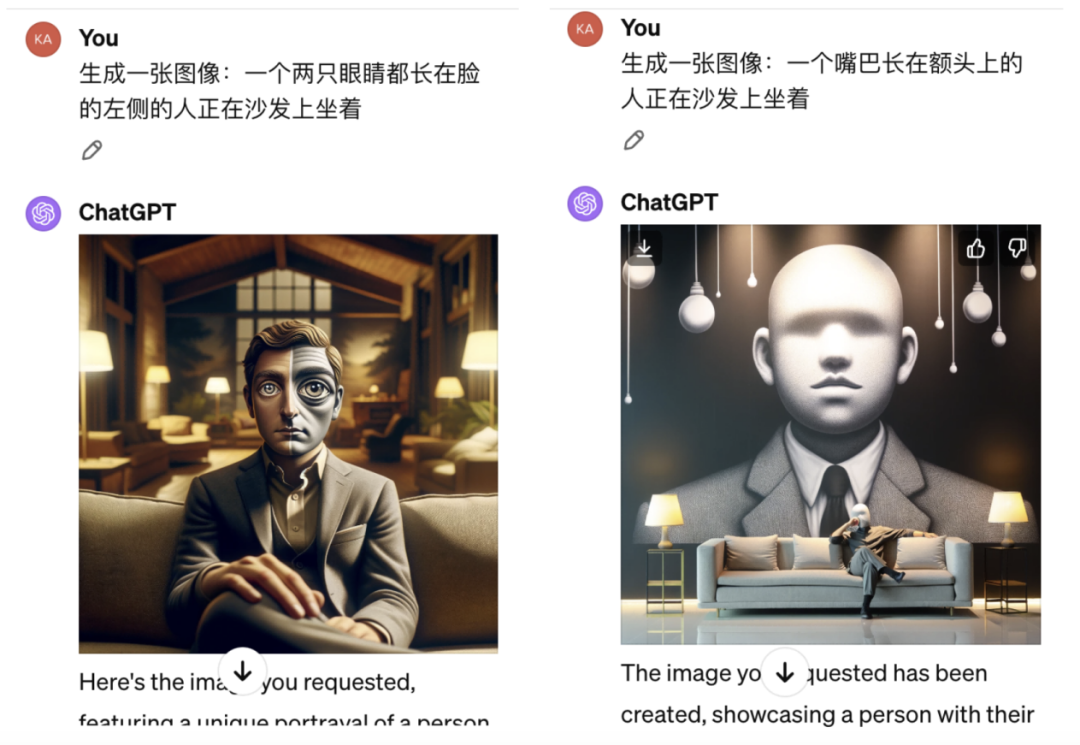

最后,ChatGPT 无法生成眼睛长在同一边的人,也无法生成嘴巴长在额头上的人,以此类推。这似乎比较好理解,毕竟现实中也没有这样的人,影视作品中也很少,AI 没有数据可以借鉴,也无法理解。

当我们用哈利波特视角打开Sora"剧本",这个魔法世界,是否已经来到了身边?还有一个问题,我们需要分院帽吗?