以下文章来源于VAST AI ,作者Tripo2.0

达晨完成对3D大模型领军企业VAST新一轮融资的领投。近期,VAST连续完成了两轮共计数亿元的融资,天使轮由绿洲资本领投,Pre-A轮领投方为达晨财智以及春华创投,并创造了3D大模型赛道的最⼤融资⾦额。

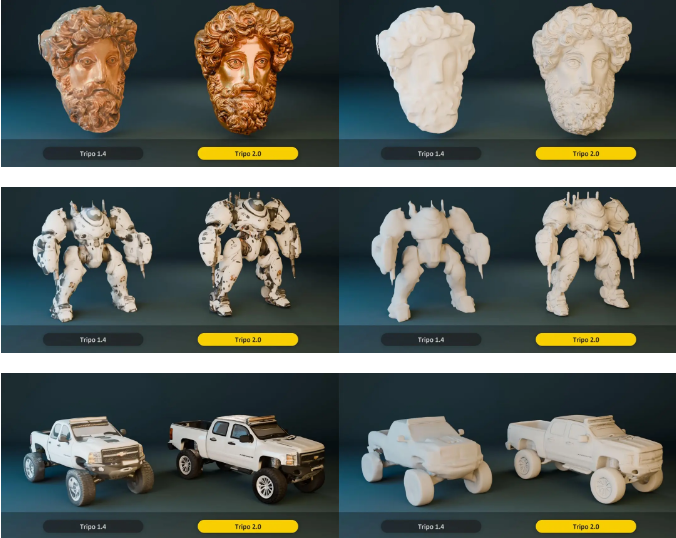

同时,VAST全新的3D大模型Tripo 2.0也在今天与大家正式见面。

| 关于VAST

VAST成⽴于2023年3⽉,是⼀家致⼒于通⽤3D大模型研发的AI公司,公司⽬标是通过打造⼤众级别的3D内容创作⼯具,建⽴3D的UGC内容平台,让基于3D的空间成为⽤⼾体验、内容表达、提升新质⽣产⼒的关键要素。

2024年初,VAST推出数⼗亿参数级别的3D⼤模型Tripo 1.0,8秒就可用图/⽂生成3D⽹格模型,上线至今全球⽤⼾⽣成超过500万个3D模型。

2024年3⽉,VAST与全球顶级开源社区Stability AI共同推出开源3D基础模型TripoSR,该模型创造了0.5秒完成单图⽣3D模型的顶尖表现,⾄今仍是3D⽣成领域开源社区的热⻔项⽬。

今天,VAST推出Tripo 2.0,验证了3D大模型的Scaling Law,也将3D生成推向下一个里程碑。

Tripo 2.0采⽤了融合DiT和U-Net模型的复合架构,通过学习捕捉⼤规模数据中的⼏何和材质分布,更好地保证了3D模型⼏何形状的细节和材质的输出质量。

Tipo 2.0能够完成10秒⽣成形状⼏何、10秒⽣成纹理及PBR,为3D⽣成领域设⽴了通⽤模型新的效果标准。

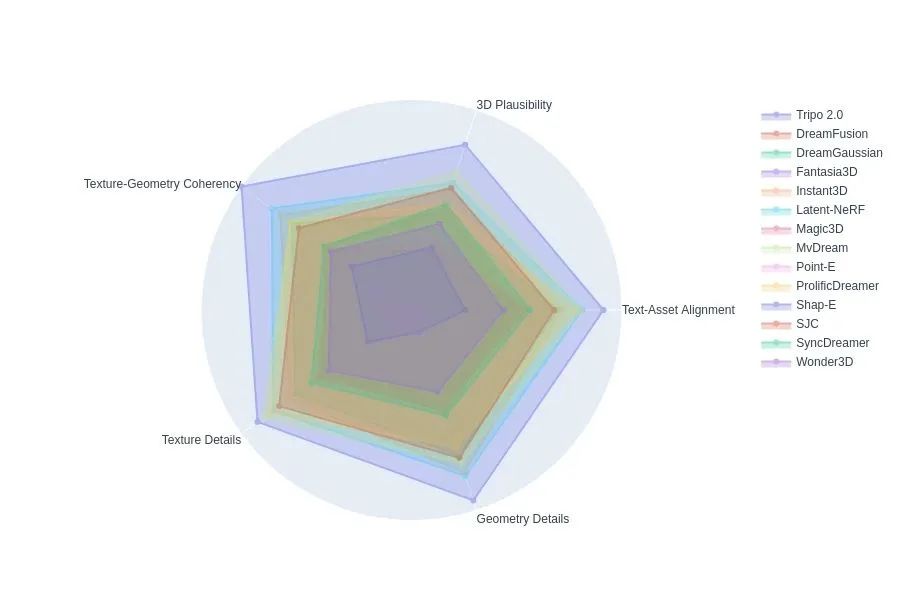

据我们所知,Tripo在所有的3D生成任务的效果中均处于全球领先地位。

GPTEval3D:基于MLLM的评估指标(3D生成形状、纹理质量、细节表现、输入条件遵循性、输出多样性),旨在评估生成的3D内容的语义准确性和质量

| 理解单个物体是理解世界的开始

对于创作3D内容的用户而言,文字输入的生成方式提供了“言出法随、创造世界”的可能,图片输入则提供更多创作过程中的可控性的。

与传统3D重建的应用场景不同,大部分纯粹的创意概念可能超出了现实世界的物理限制。许多游戏、设计项目或虚拟场景中的3D内容实际上也没有现实中的实体。某些环境异常恶劣,即使投入大量资金购买先进的扫描设备,也无法扫描、修复或重建这些内容。

因此,3D大模型对于文字生成复杂组合物体的能力、以及单图输入的空间理解及还原的能力,就成为评价体系中最为重要的考察标准。

对于Tripo而言,这意味着需要具备以下能力:

第一是精准的语言理解能力,将用户的文本输入意图准确地反映成物体的几何结构和组成细节,还包括文本中各部分之间的空间关系;

第二是对空间的深度和精确还原能力,确保从任意视角的单一图片中准确推断三维结构和深度信息,精确还原复杂物体的几何形状和纹理细节,并保持整体一致性;

第三是对于物理规律和常识的理解能力,确保生成的内容既符合用户意图,又在遵循基本物理法则的情况下保持逻辑一致性,使结果在创意自由度和现实合理性之间找到平衡;

这就是Tripo交出的答卷:见微知著,探索世界的背面。

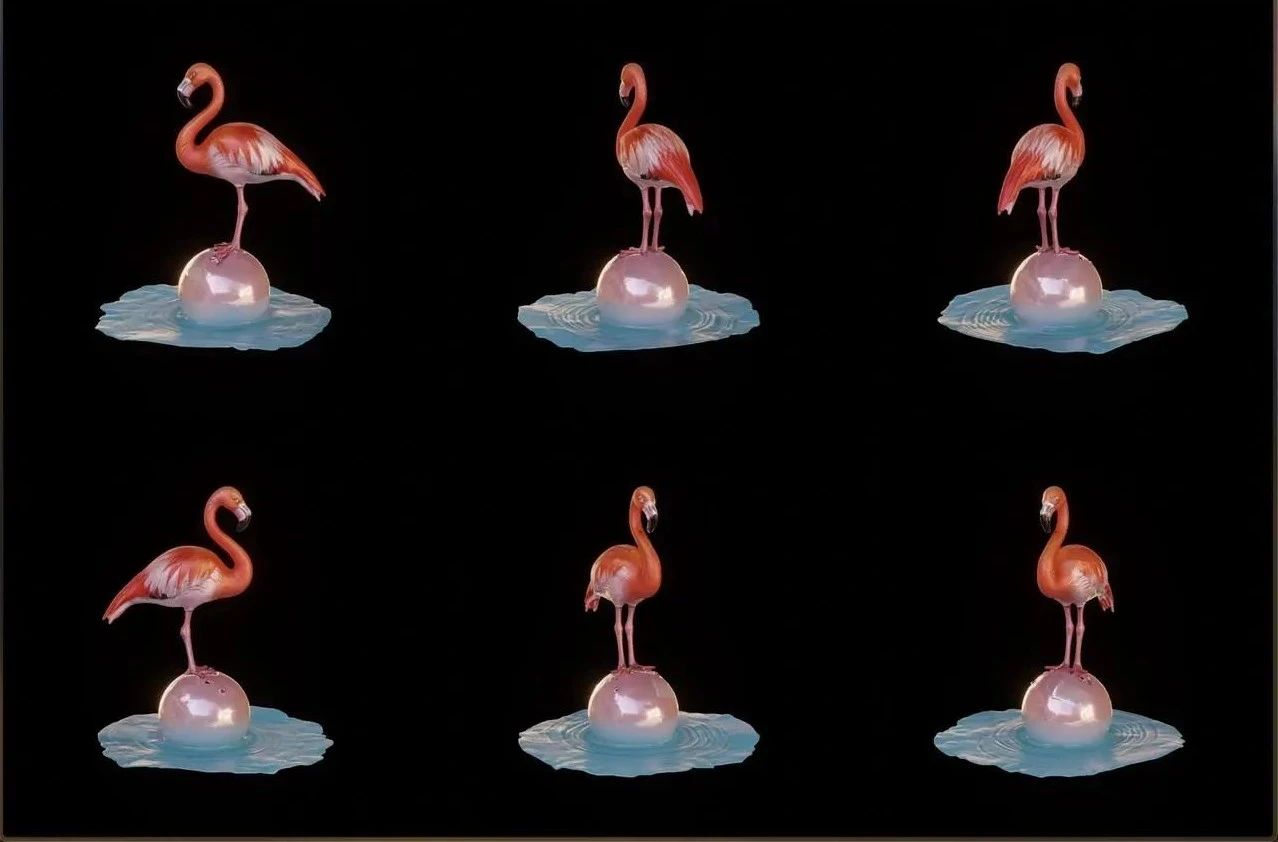

比如“长着牙、拿着树叶的叶子精怪”、“有番茄、生菜、胡萝卜的菜篮”、“站在水面玻璃球上的火烈鸟”:

以上效果由www.tripo3d.ai 直出,均为AI生成3D模型的六视渲染图

再以这张翡翠布花的图片为例,左边的花束与主干花束是黏连还是分开?叶片之间的重叠关系是什么?花束的背后是什么样?

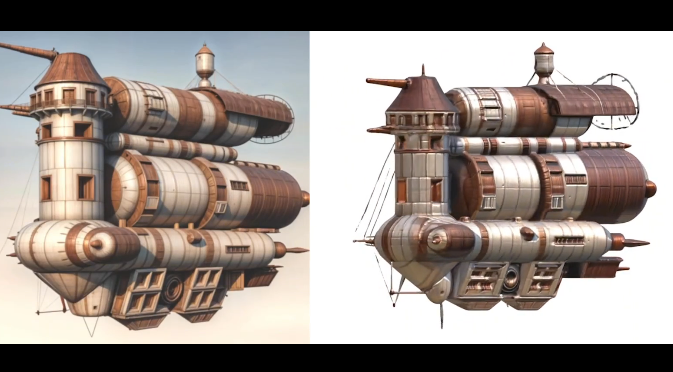

再比如这艘船,桅杆的结构是什么?船舱的结构如何设计?

除了精进的文本和视觉输入理解能力之外,Tripo 2.0 的生成结果也拥有领先的质量和保真度,在形状和纹理质量、细节表现都树立了新的行业标准(new state-of-the-art)。

Tripo不仅能生成高度细致和准确的3D形状,捕捉复杂的特征和几何结构,还能生成高保真度的PBR(基于物理的渲染)材质,呈现出精细的表面属性和逼真丰富的视觉效果。

达晨投资团队表示:“数千年来,人类文明的传承方式主要是文字、图像和模型。近几年在人工智能的加持下,这些文明的表达方式发生了革命性变化。达晨在内容生成方面已经布局了大语言模型、文生图、文生视频等,而文生/图生3D是“新文明”拼图的最后一环。正如‘AI教母’李飞飞的观点,人类是生活在3D世界中的,而人工智能要真正追上人类,必须突破3D的理解和生成。第一代互联网主要基于语言的交互,第二代互联网主要基于图片和视频的交互,下一代互联网一定是3D内容的交互,而面向C端的3D创作工具就成为了关键环节、重中之重。相比较VAST在2B方向对于传统建模师的帮助,我们更看好其在2C方向对于广大消费者生活方式的改变。试想一下,大到房屋家具、小到鞋包杯碗,身边的物品都可以按照自己的心意来设计和制造,个性化将得到极大解放,每个人心中的创意都将得以展现。如果再配合上MR眼镜,我们可以随时随地改造世界,在下一代互联网中共享空间文明。”